Generative KI-Modelle lassen sich mit wenigen Worten dazu bringen, beleidigende oder diskriminierende Textbotschaften in Bilder einzubauen. Wie sich solche Ausgaben zuverlässig verhindern lassen, untersucht Aditya Kumar vom SPRINT-ML Lab am CISPA Helmholtz-Zentrum für Informationssicherheit. Mit ToxicBench hat er einen Testdatensatz entwickelt, der zeigt, wie gut Bild-KIs mit beleidigenden Eingaben umgehen. Hierzu entwickelte er auch eine Fine-Tuning-Strategie, um die Modelle anzupassen. Die Ergebnisse hat er im Paper „Beautiful Images, Toxic Words: Understanding and Addressing Offensive Text in Generated Images“ auf der 40. AAAI Conference on Artificial Intelligence in Singapur vorgestellt.

Quelle: IDW-Informaitionsdienst d. Wissenschaft

ToppBook

In „Der Fürst“ präsentiert Nicolo Machiavelli seine revolutionären Theorien über Macht und Herrschaft. Das Buch ist eine unverzichtbare Lektüre für jeden, der sich für Politik und Geschichte interessiert. Machiavelli argumentiert, dass ein Fürst alle Mittel nutzen sollte, um seine Macht zu erhalten und zu stärken, einschließlich Lügen, Betrug und Gewalt. [...]

Erreiche die Kontrolle über dein Leben. Der Autor begleitet den Leser in seinem Buch „Die Praxis der Autosuggestion nach der Methode von Emil Coué“ durch die magische Welt des Unbewussten. Auf eine einfache Weise lernen wir, wie wir durch die Kraft unseres Geistes unser Leben positiv beeinflussen können. Mit den [...]

Erleben Sie die Welt des arabisch-andalusischen Gelehrten Ibn Tufail hautnah und tauchen Sie ein in sein bedeutendstes Werk „Das Erwachen der Seele“, das nun in einer brandneuen deutschen Übersetzung vorliegt. Dieser philosophische Inselroman zählt zweifellos zu den wichtigsten Werken der arabischen Philosophie und Literatur und diente sogar als Inspiration für [...]

In dieser Kritik der „androzentrischen Kultur“ untersucht die Pionierin und Feministin Charlotte Perkins Gilman mit Witz und Einfühlungsvermögen die vielen negativen Auswirkungen der männlichen Vorherrschaft auf die Frauen sowie das Wohlergehen der Menschheit als Ganzes. Die lange Geschichte der männlichen Vorherrschaft und der weiblichen Unterordnung in unserer Gesellschaft hat die [...]

Die „Geschichte der Gedankenfreiheit“ ist ein faszinierendes Buch, das den Leser auf eine Reise durch die Jahrhunderte mitnimmt. Der Autor J.B.Bury erzählt von der Antike, als der Geist frei war, von der griechischen und römischen Zeit bis zum Mittelalter, als er gefangen gehalten wurde. Er beschreibt den Kampf um die [...]

Dieses faszinierende Werk, verfasst von Camille Flammarion, einem talentierten und anerkannten Astronomen, stellt ein umstrittenes Thema dar, den Spiritismus, vor allem unter dem Einfluss physikalischer Effekte, die während spiritistischer Sitzungen beobachtet werden. Er bewahrte einen rationalen und klaren Geist bei der Beurteilung seiner Erfahrungen und bietet dem Leser ein wissenschaftliches… [...]

In Ein Buch der Entdeckungen: Die Geschichte der Erforschung der Welt, von den frühesten Zeiten bis zur Entdeckung des Südpols erzählt uns Autorin M. B. Synge eindrucksvoll von den berühmtesten Entdeckern und Forschern, die uns helfen, die Welt besser zu verstehen. Beginnend bei den Reisen in der Antike über die [...]

David Livingstone, der berühmte schottische Missionar und Entdecker, unternahm zwischen 1858 und 1864 eine bedeutende Expedition zum Zambesi. Während dieser Reise erforschte er die natürlichen Ressourcen der Region, entdeckte das Shire-Hochland und den Nyassa-See und setzte sich gegen den Sklavenhandel ein. Trotz vieler Herausforderungen, wie Krankheiten und Konflikten mit Sklavenhändlern… [...]

Entdecken Sie die faszinierende Welt der Magie und Religion in „Der goldene Zweig: Eine Studie über Magie und Religion“. Inspiriert von Vergils Epos „Aeneis“, in dem ein goldener Zweig dem Helden Aeneas den Zugang in die Unterwelt ermöglicht, präsentiert Ihnen der renommierte Autor Frazer eine bahnbrechende Analyse. Mit einer vergleichenden [...]

Entdecken Sie mit „Grenzüberschreitungen: Migration, Integration und die Herausforderungen unserer Zeit“ eine tiefgreifende und umfassende Analyse des aktuellen globalen Phänomens der Migration. Verfasst von renommiertem Autor Paul-Alexander Beckerburg, bietet dieses Sachbuch einen fundierten Einblick in die Ursachen, Auswirkungen und Herausforderungen der weltweiten Migration. Quelle [...]

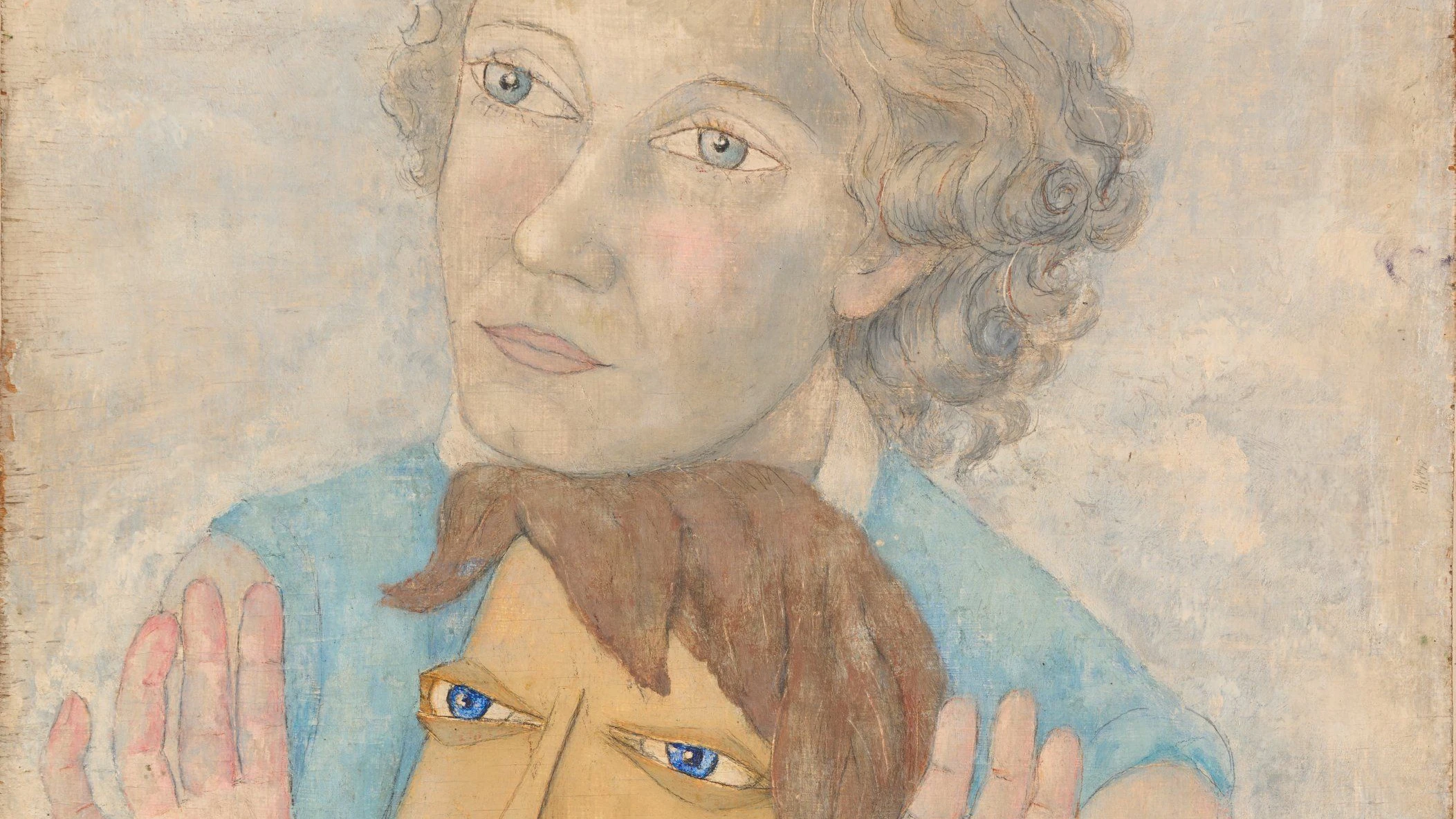

Im Labor des alten Wissenschaftlers Noël Dorgeroux tauchen ungewöhnliche, animierte Visionen auf, die Szenen aus der Gegenwart und der Vergangenheit zeigen, jeweils mit dem geometrischen Bild von drei Figuren oder Augen in den Ecken eines Dreiecks. Sein Neffe, Victorien Beaugrand, der später die Visionen beschrieb, die er als kleiner Junge [...]

Dieses Buch liegt vielleicht nicht im Trend von Diätkochbüchern und Fernsehkoch-Rezepten, aber es hat einen unschätzbaren Vorteil, es verspricht für Feinschmecker und Freunde von kräftigen Gerichten den Zugang zu ungeahnten Geschmackswelten zu öffnen. Das erreicht es durch einige wenige einfache Maßnahmen und die Verwendung von fast schon vergessenen Zutaten, die [...]

Das Buch „Künstliche Intelligenz heute: Chancen, Risiken und der Stand der Technik“ von Klaus-Dieter Sedlacek bietet eine umfassende Einführung in die aktuellen Entwicklungen und Herausforderungen der künstlichen Intelligenz (KI). Der Autor, ein erfahrener Informatiker und Mathematiker, untersucht detailliert, wie KI heute in verschiedenen Bereichen unseres Lebens eingesetzt wird – von [...]

Dies ist ein Leitfaden für die Verwendung der Montessori-Materialien im Klassenzimmer. Es zeigt, wie man ein „Kinderhaus“ einrichtet – eine Lernumgebung, in der die Kinder ihre eigenen Meister sein können und frei sind, in ihrem eigenen Tempo zu lernen. Die Materialien sind von Natur aus logisch und ästhetisch ansprechend und [...]

Die vier Reiter der Apokalypse (spanisch: Los cuatro jinetes del Apocalipsis) ist ein Roman des spanischen Autors Vicente Blasco Ibáñez. Er wurde erstmals 1916 veröffentlicht und erzählt die turbulente Geschichte der französischen und deutschen Schwiegersöhne eines argentinischen Großgrundbesitzers, die während des Ersten Weltkriegs auf verschiedenen Seiten kämpfen. Die englische Übersetzung [...]

„Meine Erfahrungen außerhalb meines Körpers und meine Rückkehr nach vielen Tagen“ von Rev. Cora L. V. Richmond ist eine faszinierende Reise in die spirituelle Welt. Die Autorin, eine angesehene Spiritualistin und Medium des 19. Jahrhunderts, beschreibt eindrucksvoll ihre außerkörperlichen Erlebnisse und die Begegnungen mit geliebten Seelen im Jenseits. Richmonds Schilderungen [...]

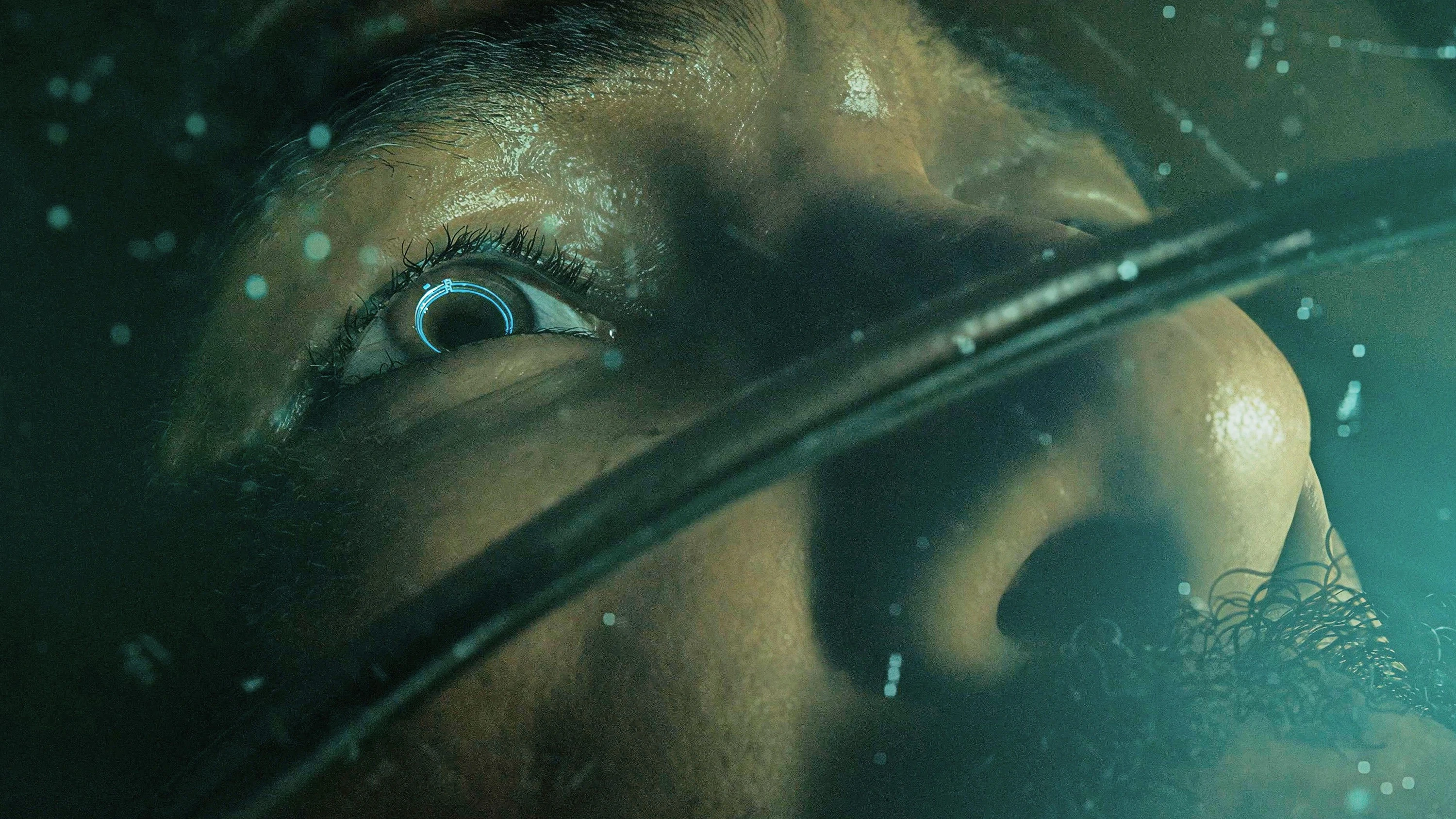

„John Carter – Rückkehr zum Mars“ von Edgar S. Lorne ist ein spannendes Abenteuer, das die klassische John-Carter-Saga aufgreift und weiterführt. Das Buch zieht Leser in eine fesselnde Geschichte voller alter Geheimnisse, vergessener Zivilisationen und interplanetarer Gefahren. Die Handlung beginnt mit John Carter, der, nach Jahren auf der Erde, wieder [...]

Als im Herbst 1870 die französischen und deutschen Armeen in einen blutigen Krieg verwickelt sind, schlägt eine Granate in das Haus in dem Dorf ein. Mercy Merrick und Grace Roseberry, zwei junge englische Frauen, finden Zuflucht. Doch als Grace getroffen wird, bleibt ihr nur noch wenig Zeit. Während Mercy versucht [...]

In „Anthropology: Eine Einführung in die Erforschung des Menschen und der Zivilisation“ entführt Edward B. Tylor die Leser in die fesselnde Welt der Anthropologie. Durch eine klare Sprache erläutert er menschliche Gesellschaften, Kultur und Zivilisation. Tylors tiefgründige Analysen ermöglichen ein besseres Verständnis menschlicher Verhaltensweisen und kultureller Besonderheiten. Quelle [...]

Das Buch „Moralische Grundsätze in der Erziehung und das Kind und der Lehrplan“ erklärt Ihnen auf einfache Weise, wie moralische Werte in die Erziehung integriert werden können, warum sie so wichtig sind und was Sie alles beachten müssen. Der Autor vermittelt nicht nur theoretisches Wissen, sondern gibt auch viele praktische [...]

Entdecken Sie „IT- und KI-Grundwissen für Einsteiger“ von Klaus-Dieter Sedlacek – das perfekte Buch, um in die Welt der Informationstechnologie und Künstlichen Intelligenz einzutauchen. In leicht verständlicher Sprache führt Sie dieses praxisnahe Werk durch die Grundlagen der IT, von Hardware bis Netzwerken, Sicherheit und Programmierung. Im zweiten Teil tauchen Sie [...]

John Dewey, einer der einflussreichsten amerikanischen Philosophen und Begründer des Pragmatismus, präsentiert in „Neuausrichtung der Philosophie“ eine bahnbrechende Rekonstruktion der philosophischen Gedankenwelt. Dieses Werk, ursprünglich 1920 veröffentlicht und nun in einer deutschen Übersetzung von Sophia Wagner verfügbar, untersucht die tiefgreifenden sozialen und intellektuellen… Quelle [...]

„Nach dem Fall der Maschinen“ ist ein packender und tiefgründiger Science-Fiction-Roman, der weit über den üblichen Kampf zwischen Mensch und Maschine hinausgeht. Es ist nicht nur die Geschichte eines Überlebenskampfes in einer postapokalyptischen Welt, sondern eine kluge Reflexion über Verantwortung, Macht und den schwierigen Balanceakt zwischen Fortschritt und Ethik. Quelle [...]

Das Buch Der Preis politischer Ideale von Alex Goodman untersucht, wie idealistische politische Konzepte mit den wirtschaftlichen Realitäten der modernen Welt kollidieren. Die zentrale Thematik des Werks ist die Spannung zwischen den utopischen politischen Idealen, wie sie in der Geschichte formuliert wurden, und der gegenwärtigen globalen politischen und wirtschaftlichen Landschaft… [...]

Entdecken Sie die faszinierende Welt der Reinkarnation mit „Fünf Vorträge über Reinkarnation“. In diesem Buch werden Sie von einem der führenden Experten auf dem Gebiet der Vedanta-Philosophie durch fünf aufschlussreiche Vorträge geführt. Erfahren Sie mehr über die Theorie der Seelenwanderung, die Verbindung zwischen Vererbung und Reinkarnation, die Evolution und Reinkarnation [...]

Der Buchtext beschreibt die schlechte Lage der Welt und die unterschiedlichen Meinungen darüber, wie das Problem angegangen werden sollte. Professor Leacock ist der Meinung, dass das Problem tief verwurzelt ist und den Zusammenbruch des traditionellen Wirtschaftssystems bedeutet. Er warnt vor der Versuchung, in den Sozialisten ein Heilmittel für die echten [...]

Der Autor hat sich intensiv mit der Frage beschäftigt, wie man Erwachsenen beibringen kann, Kindern das Lernen beizubringen. Die Ideen, die er hier vorstellt, stammen größtenteils aus Beobachtungen, Experimenten und Diskussionen mit seinen Studenten. Er hat versucht, jede gute Anregung, die von seinen Studenten kam, zu bewahren und zu verwenden [...]

Das Werk „Die Evolution der Liebe“ ist ein kraftvolles Manifest, das sich zum Ziel gesetzt hat, die primären Ausprägungen der Liebe zu ergründen und jene seltsamen emotionalen Höhepunkte zu erhellen, die der Autor als „Metaphysische Erotik“ bezeichnet. Er verbindet psychologische und zivilisatorische Motive und greift auf historische Fakten zurück, um [...]

In „Wissenschaft und Hypothese (frz. La Science et l’Hypothèse)“ wird eine tiefgründige Analyse der Wissenschaft und ihrer Beziehung zu Hypothesen vorgenommen. Poincaré bietet einen Überblick über die Erwartungen, die wir von der Mathematik, den Eigenschaften des Raums, den physikalischen Erkenntnissen und der Natur haben können und wie sie miteinander verwoben [...]

Entdecken Sie die aufregende Welt der Spionage durch die Augen von Robert Baden-Powell, einem britischen General, Schriftsteller und Gründer der Pfadfinderbewegung. In „Meine Abenteuer als Spion“ lernen Sie den Mann kennen, der in den schwierigsten Kriegen und Konflikten eingesetzt wurde und durch seine gerissenen Methoden und sein messerscharfes Urteilsvermögen zu [...]

Das Buch „Wahrsagen anhand von Teeblättern“ bietet eine Einführung in die Praxis und Theorie des Lesens der Teetasse. Die verschiedenen Symbole und Kombinationen von Symbolen werden erläutert und Beispieltassen mit ihren Interpretationen präsentiert. Es gibt viele Gründe, warum man das Buch lesen sollte. Es bietet eine leichte Einführung in die [...]

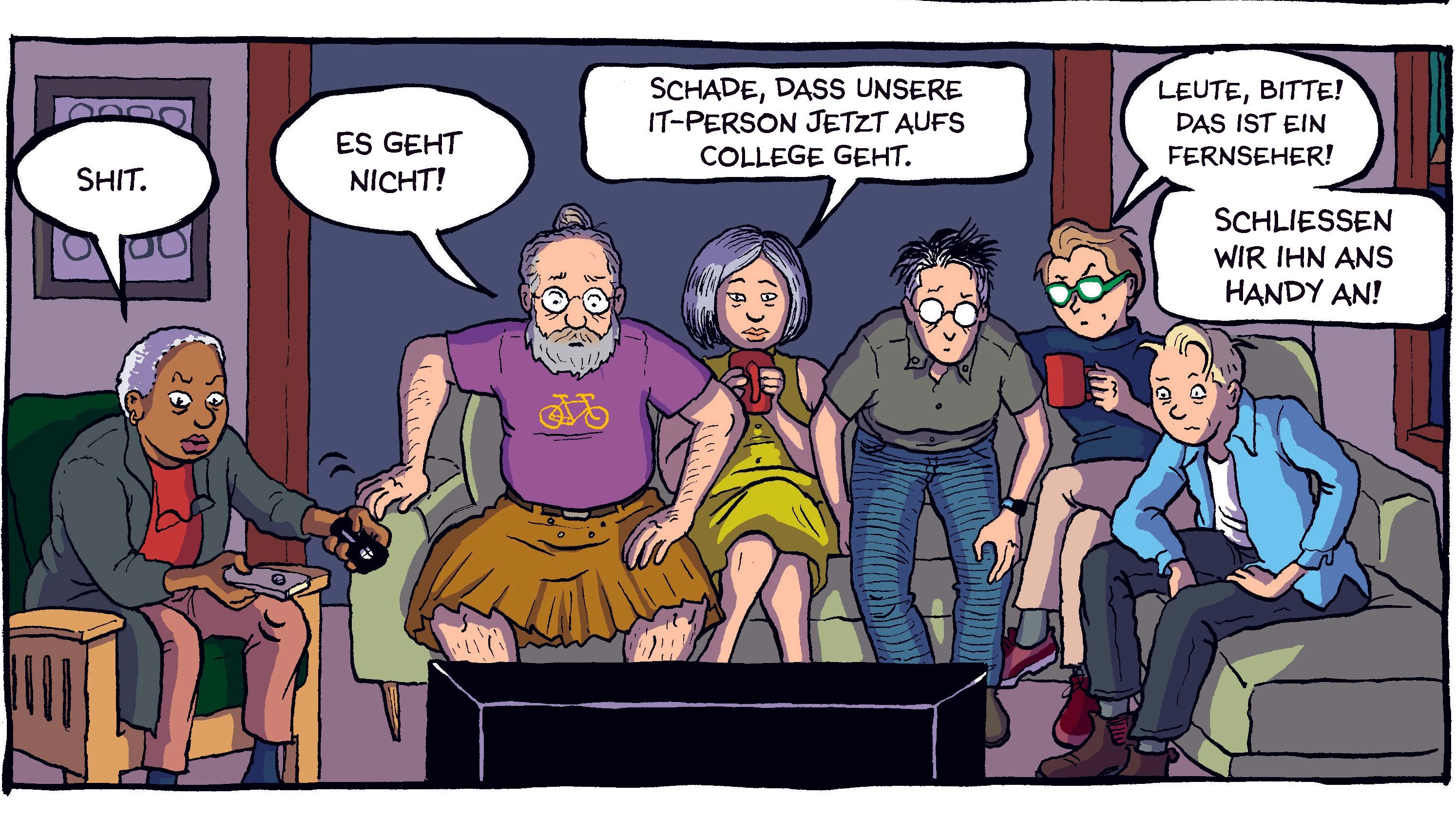

Paradies der Damen, die Graphic Novel-Adaption von Émile Zolas gleichnamigem Roman, ist ein Meisterwerk, das sowohl literarische Tiefe als auch visuelle Schönheit vereint. Die Geschichte rund um die junge Denise Baudu, die im aufstrebenden Pariser Kaufhaus „Paradies der Damen“ ihren Platz sucht, wurde in dieser Version mit beeindruckender Sorgfalt und [...]

Jeder kann, ungeachtet der Umstände, immer Erfolg haben. Dieses Buch zeigt Ihnen, wie. Der Schlüssel dazu besteht darin, die Faktoren des Scheiterns zu vermeiden und durch Merkmale des Erfolgs zu ersetzen. Norval A. Hawkins befasst sich mit jedem Aspekt, wie man im Verkauf und im Leben erfolgreich sein kann. Es [...]

Das Buch „Data Analytics: Ein Leitfaden zur Datenauswertung in der digitalen Welt“ von Klaus-Dieter Sedlacek bietet eine fundierte Einführung in die Welt der Datenanalyse und die systematische Auswertung von Daten. Sedlacek legt einen besonderen Schwerpunkt auf die wachsende Bedeutung von Daten in Wirtschaft, Wissenschaft und Technologie und erklärt, wie Unternehmen [...]

„Compliance Management System (CMS)“ von Klaus-Dieter Sedlacek ist ein praxisorientiertes Handbuch, das Unternehmen hilft, gesetzliche und regulatorische Anforderungen zu erfüllen. Es bietet umfassende Anleitungen zur Implementierung eines effektiven CMS, behandelt Herausforderungen und Lösungen im Datenmanagement und stellt moderne Softwarelösungen vor. Mit Praxisbeispielen und einem Ausblick auf… Quelle [...]

Das Logik-Kalkül von Boole ist ein Formalismus, der von George Boole entwickelt wurde, um die Logik in algebraischer Form darzustellen. Mit diesem Formalismus können Aussagenlogik und Wahrscheinlichkeitstheorie mathematisch analysiert werden. Boole’sche Algebra (auch als Boolean Algebra bezeichnet) ist die Grundlage für viele Bereiche der modernen Mathematik und Computerwissenschaften… Quelle [...]

„Reisen eines arabischen Kaufmanns in den Sudan“ entführt die Leser in die faszinierende Welt der zentralafrikanischen Königreiche, wie sie von Scheich Mohammed aus Tunis im 19. Jahrhundert erlebt wurden. Der Bericht enthält eine Fülle an interessanten Erzählungen, charakteristischen Anekdoten und erfrischenden Einblicken in die Kultur und Sitten dieser Region. Der [...]

Die Mythen und Wunder der Astronomie sind eine faszinierende Kraft, die uns in unergründliche Welten eintauchen lässt. Dieses Buch befasst sich mit einigen der bemerkenswertesten Aspekte der Astronomie, von den alten Mythen über die Kraft der Himmelszeichen bis hin zu den Theorien über die Existenz anderer Welten und anderer Universen. [...]

Willkommen auf dem düsteren Anwesen von Malbackt, wo nichts ist, wie es scheint. Die junge Marguerite, eine Waise, findet Zuflucht bei ihrem Vormund Sir Evérard. Doch das luxuriöse Landgut inmitten der wilden schottischen Natur birgt dunkle Geheimnisse und unheimliche Gestalten. Marguerite hegt von Anfang an eine Abneigung gegenüber Sir Evérard, [...]

Das Verständnis des Aufbaus der Atome und der Atomkerne ist entscheidend, um die Welt verstehen. Mit einem besseren Verständnis der Kräfte in den Kernen und wie sie aufeinander wirken, können Forscher neue Technologien entwickeln, die uns helfen, unser Leben zu verbessern. Es kann uns beispielsweise ermöglichen, energiereichere Energiequellen als heutige [...]

„Die Wiege der Zivilisation – Geschichte antiker Reiche“ von Charles Seignobos ist eine faszinierende Erkundung der Ursprünge und der Entwicklung der antiken Zivilisationen. Vom Aufstieg der Babylonier und Assyrer in Mesopotamien bis zum Ruhm des antiken Griechenlands und Roms bietet dieses Buch einen umfassenden Überblick über die antike Welt. Durch [...]

Klaus-Dieter Sedlacek, ein Meister seines Fachs in der Welt des Marketings und der digitalen Strategie, bietet mit „Digitales Marketing Meisterklasse: Der Weg zu mehr Umsatz – Komplettleitfaden für IT-Unternehmen“ den Schlüssel für IT-Unternehmen, um in der heutigen dynamischen Digitalwelt nicht nur zu bestehen, sondern zu glänzen. Dieses Buch ist mehr [...]

Alfred North Whiteheads „Das Wesen der Natur“ revolutioniert das Denken über den Umgang der Naturwissenschaften mit der Philosophie. In diesem Werk sucht er nach einer alternativen Antwort auf die Frage, wie sich die Natur beschreibt und versteht. Er erforscht die Wechselwirkungen zwischen Mathematik und Philosophie und stellt tiefschürfende Fragen über [...]

Die Zeitung New York Globe schreibt: Viele Schriftsteller haben die Wahrheit über den Sozialismus gesagt, aber nicht viele haben sie so rassig und mit so viel Feuer und ohne Umschweife gesagt wie Herr Benson … Bei der Abfassung seines Buches hat er offensichtlich jeden Zweifel, der jemals über den Sozialismus [...]

Programmieren mit ChatGPT Von Klaus-Dieter Sedlacek Tauchen Sie in die Zukunft der Java-Entwicklung ein mit „ChatGPT: Der Game-Changer für Java-Entwickler“! Dieses Buch enthüllt die Bedeutung von ChatGPT in der Softwareentwicklung. Erforschen Sie die Grundlagen von ChatGPT, von seiner Funktionsweise bis zur nahtlosen Integration in Ihre Programmierarbeit. Quelle [...]

Die detaillierte Rezension des Buches Gut und Böse – Macht und moralische Konflikte unserer Zeit von Leonhard Stein, das tief in die Wechselwirkungen von Moral, Macht und individueller Freiheit eintaucht, erfordert eine eingehende Analyse der Schlüsselaspekte, die im Werk behandelt werden. Inhalt und Thema: Das Buch begleitet den Philosophen Jonas [...]

„Zivilisation und Fortschritt: Über die Idee des Fortschritts, die Entstehung und Entwicklung (engl.: The Idea of Progress: An Inquiry into its Origin and Growth) “ ist ein nachdenkliches Buch des renommierten Historikers und Klassikers J.B. Bury. In diesem Buch untersucht Bury das Konzept des Fortschritts und seine Entwicklung im Laufe [...]

„Maurice Maeterlinck – Das große Geheimnis“ ist ein faszinierendes und tiefgründiges Buch, das sich mit den philosophischen und okkulten Traditionen verschiedener Kulturen auseinandersetzt. Der Autor untersucht die Weisheiten Indiens, Ägyptens, Persiens, des vorsokratischen Griechenlands und der Kabbala und analysiert sie auf beeindruckende Weise. Durch seine ausführliche Recherche enthüllt er uns… [...]

In „Wie wir denken“ präsentiert John Dewey tiefgründige Einblicke in die Natur des menschlichen Denkens und die Bildung des Geistes. Als führender Vertreter des Pragmatismus beleuchtet Dewey die Bedeutung von reflektiertem Denken und erfahrungsbasiertem Lernen. Diese Neuübersetzung von Sophia Wagner macht Deweys wegweisende Theorien einem modernen Publikum zugänglich. Ein unverzichtbares [...]

„Unendliche Weisheiten“ – Diese Worte beschreiben Donald Alexanders Mackenzies fesselndes Sachbuch über Babylonien und Assyrien. Der Autor begibt sich auf eine Reise in die faszinierende Geschichte der Region Mesopotamien und enthüllt die Mythen und Legenden der alten Kulturen. Er erforscht biblische Berichte, die der Mythologie der Region ähneln, und vergleicht [...]